Das KI-Update für die Woche 19-2026

02.05. - 08.05.

Liebe KI-Enthusiasten,

herzlich willkommen zu einer neuen Ausgabe unseres KI-Newsletters, der Sie über die neuesten Entwicklungen und Innovationen in der Welt der künstlichen Intelligenz auf dem Laufenden hält.

Wichtigste Punkte heute

🤖 GPT-5.5 Instant: Weniger Halluzinationen, natürlicherer Ton – OpenAI optimiert für den Alltag statt für Benchmarks

🚀 Anthropic & SpaceX: Claude-Nutzer bekommen doppelte Nutzungslimits dank 220.000 NVIDIA-GPUs

📊 McKinsey-Warnung: Weniger als 10 % der Unternehmen skalieren KI-Agenten erfolgreich – Datenqualität ist der Flaschenhals

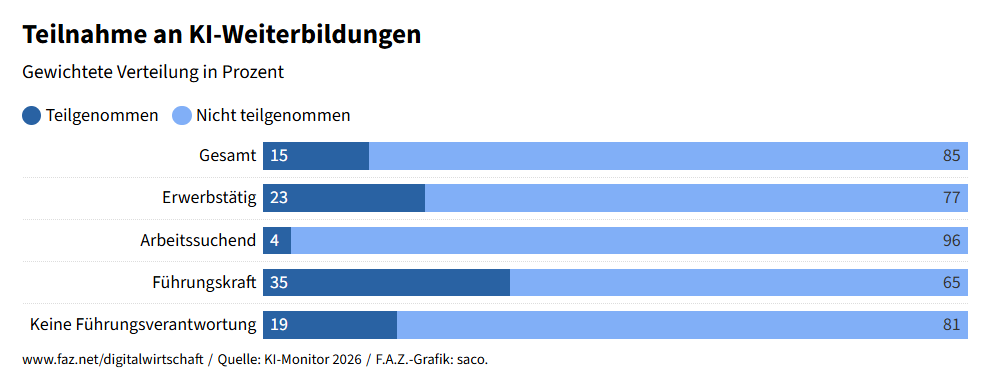

🧑💼 77 % der deutschen Erwerbstätigen haben noch nie an einer KI-Schulung teilgenommen – Zahlen aus der Praxis, die nachdenklich machen

Viel Spaß

Ihr

Martin Blaha

🔥 Gefällt Ihnen unser Newsletter? Unterstützen Sie unsere Arbeit, in dem Sie uns Ihren Freunden und Kollegen empfehlen:

Produktneuheiten

Copilot Cowork: Von Gesprächen zu mobilen Aktionen

Microsoft kündigt neue Features für Copilot Cowork an: Die Assistenz-KI geht über reine Dialogfunktionen hinaus und unterstützt jetzt aktiv bei Aufgaben und Workflows - sogar auf mobilen Geräten. Die sogenannten Skills ermöglichen es, eigene Arbeitsabläufe zu speichern und zu automatisieren. Dank tiefer Integration in Microsoft- sowie Drittanbieter-Anwendungen wie Power BI, Dynamics 365 oder Miro lässt sich Copilot Cowork flexibel an Unternehmensprozesse anpassen, fördert Zusammenarbeit im Team und erleichtert so spürbar den Arbeitsalltag.

Gemini 3.1 Flash-Lite: Ultraschnelle KI für Unternehmens-Workflows

Google stellt Gemini 3.1 Flash-Lite als neue, extrem schnelle und kostengünstige KI-Lösung vor. Das Modell überzeugt durch niedrige Latenz und hohe Effizienz, was es ideal für Echtzeit-Anwendungen in Entwicklung, Kundenservice, Gaming und Finanzen macht. Firmen wie JetBrains, Gladly und Ramp berichten von deutlich verbesserten Reaktionszeiten und sinkenden Kosten.

Veröffentlichungen und Ankündigungen

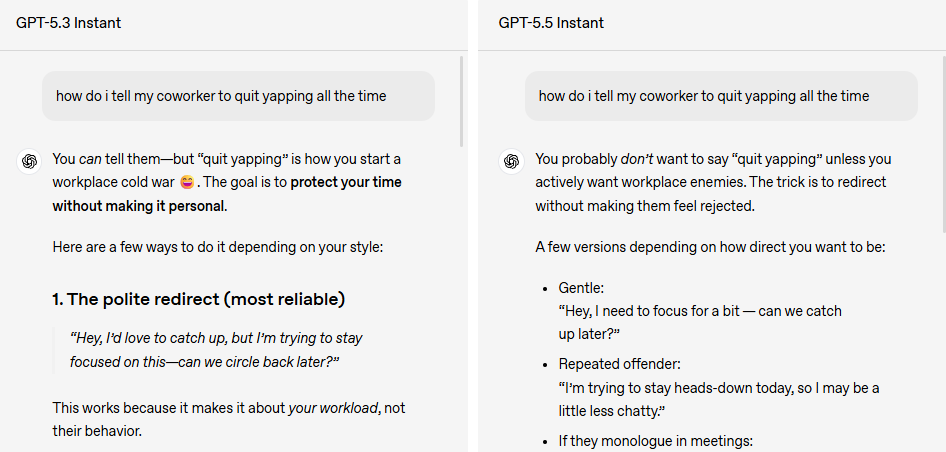

GPT‑5.5 Instant macht ChatGPT präziser und persönlicher

OpenAI hat mit GPT‑5.5 Instant einen neuen Standard‑Modell für ChatGPT eingeführt, der gezielt auf stabilere, klarere und persönlichere Antworten ausgerichtet ist. Der Fokus liegt weniger auf „größer wird besser“ als auf Alltagstauglichkeit: Weniger Halluzinationen, kürzere Antworten, ein natürlicherer Ton und eine bessere Nutzung von gespeichertem Kontext (Chats, Dateien, Gmail) heben die Qualität der Standardnutzung spürbar an.

OpenAI stellt MRC-Protokoll für Supercomputer vor

OpenAI hat zusammen mit AMD, Broadcom, Intel, Microsoft und NVIDIA das Multipath Reliable Connection (MRC)-Protokoll veröffentlicht, ein offenes Netzwerkprotokoll über das Open Compute Project (OCP). Es basiert auf RoCE-Erweiterungen und SRv6-Routing, um Daten in großen AI-Trainings-Clustern zuverlässig über Hunderte Pfade zu verteilen, Ausfälle zu umgehen und GPU-Wartezeiten zu minimieren. Ziel ist schnellere, stabilere Trainings großer Modelle; MRC läuft bereits produktiv auf OpenAIs größten Supercomputern wie Fairwater und OCI in Texas.

Gemma 4 wirft den Turbo an: Google beschleunigt KI mit Multi‑Token‑Prediction

Google beschleunigt seine offene Gemma‑4‑Modellfamilie mit sogenannten Multi‑Token‑Prediction (MTP) „Draftern“, die bis zu dreimal schnellere Inference ermöglichen, ohne Ausgabegüte oder Schlussfolgerungsqualität zu opfern. Die Technik basiert auf „speculative decoding“: Ein leichter Drafter errät mehrere Tokens parallel, die dann vom schweren Zielmodell in einem Zug verifiziert werden, was die Latenz deutlich senkt. Für Entwickler heißt das: schnellere Chat‑Interfaces, agente‑fähige Workflows und leistungsfähigere On‑Device‑KI auf Workstations und Mobilgeräten - alles bei gleicher Qualität wie zuvor.

Industrienachrichten

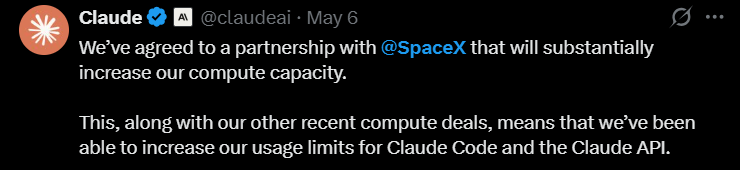

Anthropic baut KI-Kapazitäten mit SpaceX deutlich aus

Anthropic hat eine Partnerschaft mit SpaceX geschlossen und erhält exklusiven Zugang zum neuen Colossus 1 Supercomputer. Dieser umfasst über 220.000 NVIDIA-GPUs und sorgt dafür, dass die Nutzungslimits für den KI-Dienst Claude für Pro-, Max- und Enterprise-Kunden verdoppelt werden. Das gesteigerte Rechenpotenzial ermöglicht eine bessere Performance und Skalierbarkeit. Zudem prüfen Anthropic und SpaceX gemeinsam die Entwicklung von orbitalen Rechenzentren im All, um Kapazitätsengpässe auf der Erde künftig zu umgehen.

👉 Mitteilung von Anthropic | 👉 Mitteilung von xAI

Bolt.new und Microsoft Azure: KI-gestütztes App-Entwickeln für Unternehmen vereinfachen

Bolt.new, die KI-basierte Entwicklungsplattform von Stackblitz, ist ab sofort über den Microsoft Marketplace verfügbar und lässt sich nahtlos mit Microsoft Azure und Microsoft 365 integrieren. Unternehmen können damit Ideen direkt aus Microsoft Teams in fertige Anwendungen umwandeln und den Code sofort in die eigene Azure-Umgebung integrieren. Das Ergebnis: Deutlich verkürzte Projektlaufzeiten, reduzierte Teamgrößen und ein einfacher Weg, alle Plattformen (Web, iOS, Android) gleichzeitig zu bedienen.

ServiceNow und NVIDIA erweitern KI‑Governance von Desktops bis ins Rechenzentrum

ServiceNow erweitert zusammen mit NVIDIA die Kontrolle über KI-Anwendungen: Mit Project Arc startet ein autonomer Desktop-Agent, gesichert durch NVIDIA OpenShell und überwacht vom ServiceNow AI Control Tower. Damit wird KI-Governance nicht nur auf Desktops, sondern erstmals auch auf große Modell-Workloads im Rechenzentrum ausgeweitet. Ein offener Benchmark-Standard hilft Unternehmen, ihre KI-Performance messbar und sicher zu gestalten. Projekt Arc ist als Early Preview verfügbar, die neuen Governance-Funktionen stehen Unternehmen bereits zur Verfügung.

EVE Online startet eine neue Ära als Fenris Creations

EVE Online entwickelt sich fortan unter dem neuen Namen Fenris Creations unabhängig weiter. Das Studio bleibt unverändert, wirtschaftlich läuft es stabil. Neu ist eine Partnerschaft mit Google DeepMind, um Künstliche Intelligenz im Kontext von Spielerinteraktionen zu erforschen – zunächst abseits des Live-Spiels.

Zahlen, Studien, Wissenschaft

Informatikwissen statt KI‑Dauerbetrieb - Was gute Vibe‑Coder wirklich ausmacht

Eine Studie zeigt: Gute Vibe-Coder überzeugen vor allem durch Teamwork, technische Flexibilität und Kreativität. Informatiker bringen oft die besten Voraussetzungen, weil sie analytisches Denken mitbringen und sich schnell auf neue Werkzeuge einstellen können. Weniger hilfreich sind Einzelkämpfertum und starres Festhalten an einmal gelernten Methoden, denn die Szene lebt vom Austausch und der Bereitschaft, ständig Neues auszuprobieren.

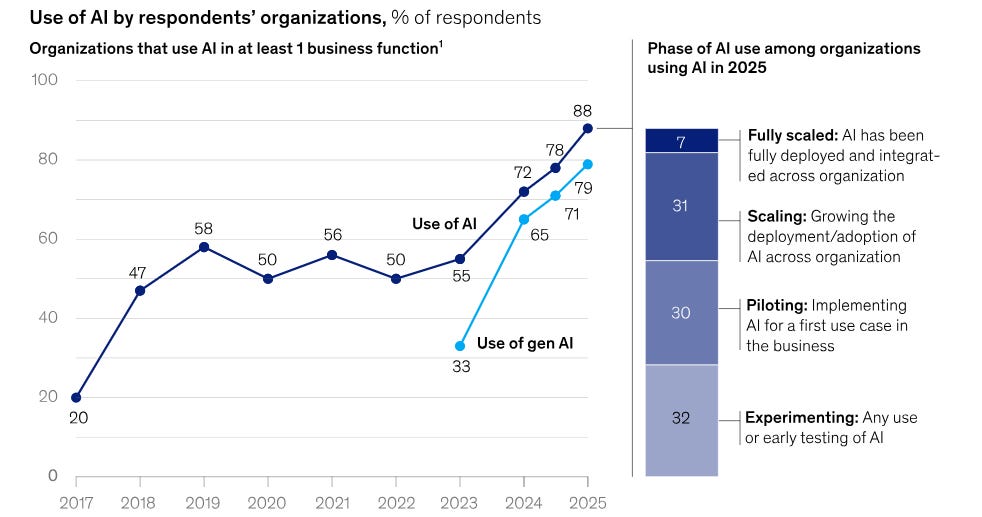

Data als Fundament für agentic AI

Unternehmen experimentieren zunehmend mit autonomen KI‑Agenten, doch laut McKinsey schaffen es weniger als zehn Prozent, diese im großen Maßstab wertstiftend zu skalieren. Hauptursache sind fragmentierte oder minderwertige Daten: acht von zehn Unternehmen sehen hier die zentrale Hürde. McKinsey betont, dass erst klare, hochwertige Daten, eine moderne Architektur sowie eine robuste Governance und Betriebsstruktur geschaffen werden müssen, bevor Workflows „agentifiziert“ werden. So wird Datenqualität zum strategischen Wettbewerbsvorteil im Zeitalter agentic AI.

The Anthropic Institute setzt Forschungsschwerpunkte bei KI-Auswirkungen

The Anthropic Institute (TAI) veröffentlicht eine klare Forschungsagenda, die vier zentrale Themenfelder abdeckt: ökonomische Diffusion, Risiken und Resilienz, KI-Nutzung im Alltag sowie KI-gestützte Forschung. Im Fokus steht, wie KI-Modelle Gesellschaft, Arbeit und Sicherheit beeinflussen. Eigene Datensammlungen, offene Ergebnisse und der Dialog mit externen Experten prägen den Ansatz.

KI-Kompetenz in Unternehmen bleibt häufig nur ein Lippenbekenntnis

Trotz der allgemeinen Anerkennung der Bedeutung von KI-Kompetenzen investieren viele Unternehmen kaum in die Qualifizierung der Mitarbeitenden. Empirische Daten zeigen: 77 Prozent der Erwerbstätigen in Deutschland haben noch nie an einer KI-Schulung teilgenommen. Besonders Führungskräfte, nicht aber die breite Mitarbeiterschaft, werden weitergebildet. Produktivitätsgewinne entstehen aber erst, wenn KI nicht nur eingeführt, sondern auch aktiv und kritisch genutzt wird.

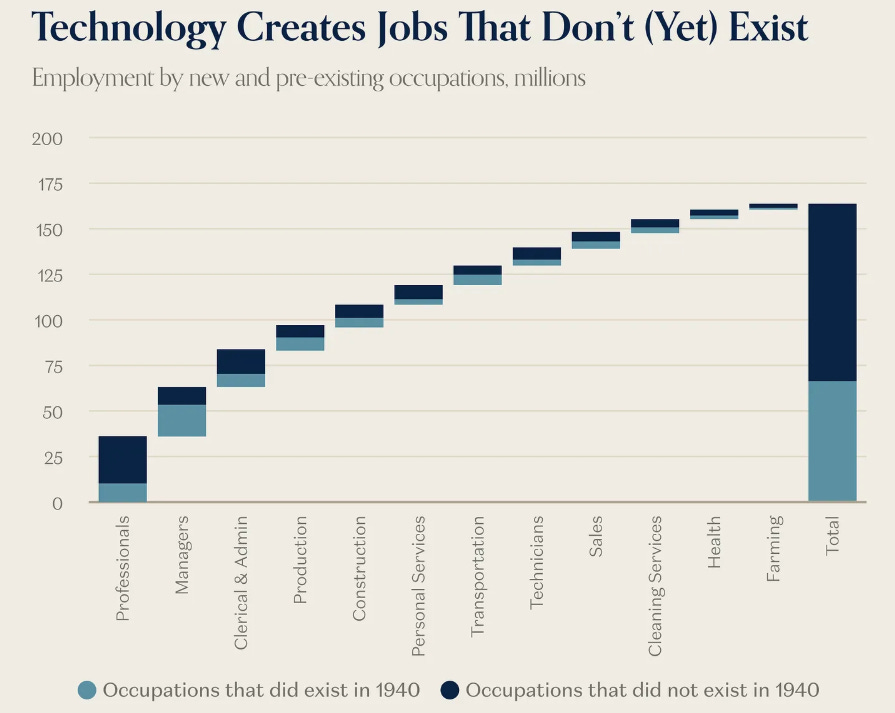

Kein KI-Arbeitsmarkt-Kollaps, sondern Umbau

a16z weist die These eines „AI Job Apocalypse“ zurück und nennt sie eine moderne Variante des „lump-of-labor“-Fehlschlusses: Arbeit sei nicht fix, sondern verschiebe sich mit Produktivität und neuen Bedürfnissen. Der Text argumentiert, KI werde zwar Aufgaben verdrängen und manche Rollen verkleinern, aber nicht zu dauerhafter Massenarbeitslosigkeit führen. Stattdessen verweist der Autor auf historische Technologiewellen, neue Jobs und aktuelle Daten, die bislang eher auf Umverteilung als auf einen starken Beschäftigungseinbruch hindeuten.

Ich wünsche Ihnen ein schönes Wochenende!

Prompt Well and Prosper!

Ihr

Martin Blaha

Das KI-Update ist eine wöchentliche Publikation, die von Martin Blaha (3pconsulting.net) produziert wird. Kontakt- und Geschäftsanfragen gerne über LinkedIn.