Das KI-Update für die Woche 16-2026

11.04. - 17.04.

Liebe KI-Enthusiasten,

herzlich willkommen zu einer neuen Ausgabe unseres KI-Newsletters, der Sie über die neuesten Entwicklungen und Innovationen in der Welt der künstlichen Intelligenz auf dem Laufenden hält.

Wichtigste Punkte heute

➡️ Claude Opus 4.7: Deutlicher Schritt nach vorne bei komplexer Softwareentwicklung und Agentenaufgaben

🧠 MiniMax M2.7 nimmt an seiner eigenen Weiterentwicklung teil – KI-Modelle, die sich selbst optimieren, sind keine Zukunftsmusik mehr

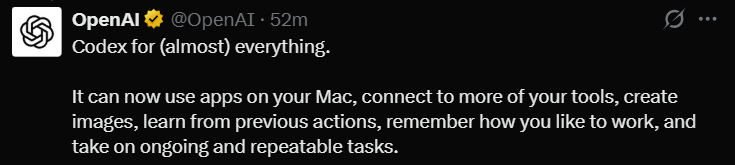

🔧 OpenAI Codex wird zum universellen Agenten: Apps bedienen, Aufgaben parallelisieren, Kontext merken – alles in einer Desktop-App

📊 Stanford-Studie: Warum KI-Produktivität Zeit braucht – und warum die meisten Unternehmen noch auf den Durchbruch warten

Viel Spaß

Ihr

Martin Blaha

🔥 Gefällt Ihnen unser Newsletter? Unterstützen Sie unsere Arbeit, in dem Sie uns Ihren Freunden und Kollegen empfehlen:

Produktneuheiten

Anthropic lanciert Claude Opus 4.7 - Sprung bei anspruchsvoller Softwareentwicklung

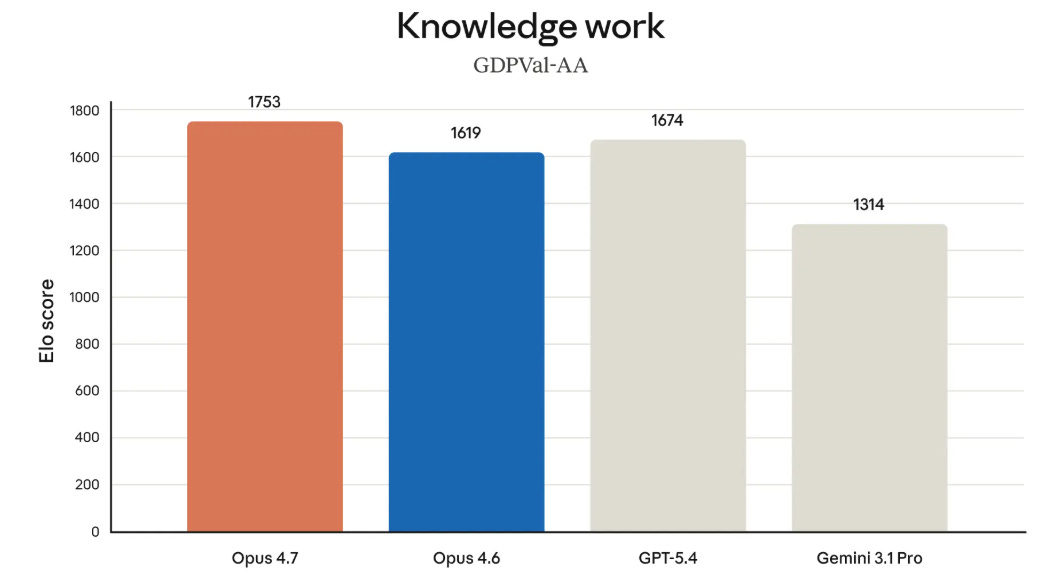

Anthropic stellt Claude Opus 4.7 vor, eine deutliche Verbesserung gegenüber Opus 4.6 bei komplexer Softwareentwicklung. Das Modell meistert schwierige Codieraufgaben eigenständig, folgt präzise Anweisungen und verifiziert eigene Ausgaben. Es zeigt Fortschritte bei Agentenaufgaben, Vision-Auflösung und Tool-Nutzung. Preislich unverändert: 5 USD pro Mio. Input-, 25 USD pro Mio. Output-Tokens. Verfügbar auf allen Claude-Plattformen, API und Cloud-Diensten wie Amazon Bedrock.

OpenAI Codex - Der universelle Coding-Agent für alles?

OpenAI hat Codex grundlegend erweitert: Die KI kann nun Apps per Maus und Tastatur nutzen, mehrere Aufgaben parallel erledigen und sich Kontexte wie Vorlieben oder frühere Anweisungen merken. Die neue Desktop-App integriert über 90 Plugins, ein eigenes Browser-Fenster für Web-Automatisierung, Bildgenerierung mit gpt-image-1.5 und eine zentrale Übersicht über Projekte. Codex unterstützt Workflows von Code-Erstellung bis langfristige Aufgabenplanung und hilft, nahtlos zwischen Tools wie Slack, Gmail und Notion zu wechseln.

Qwen3.6-35B-A3B: Offenes MoE-Modell setzt neuen Leistungsmaßstab

Qwen3.6-35B-A3B ist ein sparsames Mixture-of-Experts-Modell mit 35 Milliarden Parametern (3 Mrd. aktiv), das außergewöhnliche Ergebnisse beim agentengestützten Codieren liefert. Es schlägt seinen Vorgänger Qwen3.5 deutlich und kann bei vielen Aufgaben mit größeren dichten Modellen wie Gemma4-31B konkurrieren. Das Modell glänzt nicht nur beim Programmieren, sondern beeindruckt auch bei multimodalen Benchmarks.

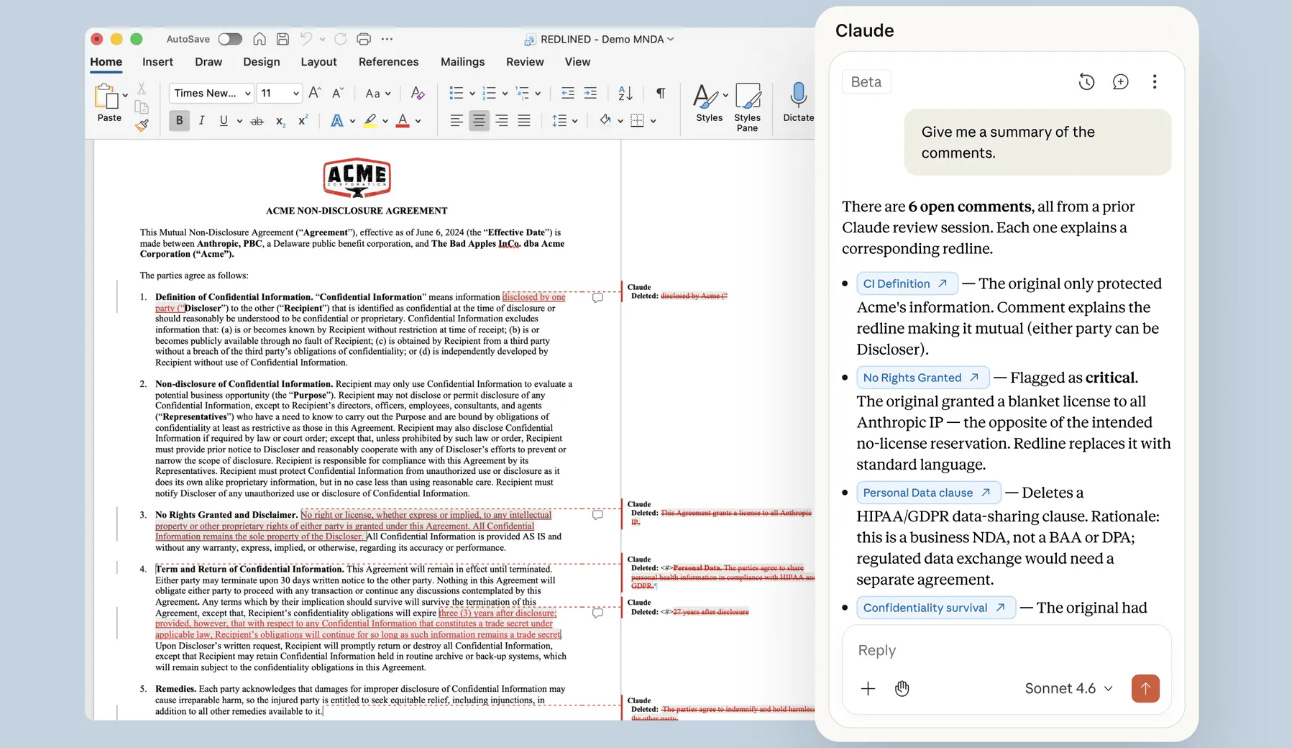

Claude direkt in Word

Anthropic stellt mit Claude for Word ein Beta-Add-in vor, das Claude direkt in Microsoft Word integriert - speziell für Profis in Recht, Finanzen und Editing. Es ermöglicht Fragen zu Dokumenten mit Zitaten, gezielte Textbearbeitung unter Erhalt von Formatierung, Tracked Changes für Änderungen sowie Bearbeitung von Kommentaren und Vorlagenfüllung.

MiniMax M2.7: Erste Schritte zur Selbst-Evolution von KI-Modellen

MiniMax stellt mit M2.7 sein erstes Modell vor, das aktiv an seiner eigenen Weiterentwicklung teilnimmt. Der chinesische KI-Anbieter beschreibt in der Ankündigung, wie M2.7 komplexe Agenten-Systeme aufbaut, um Reinforcement-Learning-Experimente zu optimieren und Leistungen um 30% zu steigern. Es glänzt in Software-Engineering (SWE-Pro: 56,22%), Office-Aufgaben (GDPval-AA: ELO 1495) und ML-Wettbewerben (66,6% Medaillenrate). Verfügbar via API.

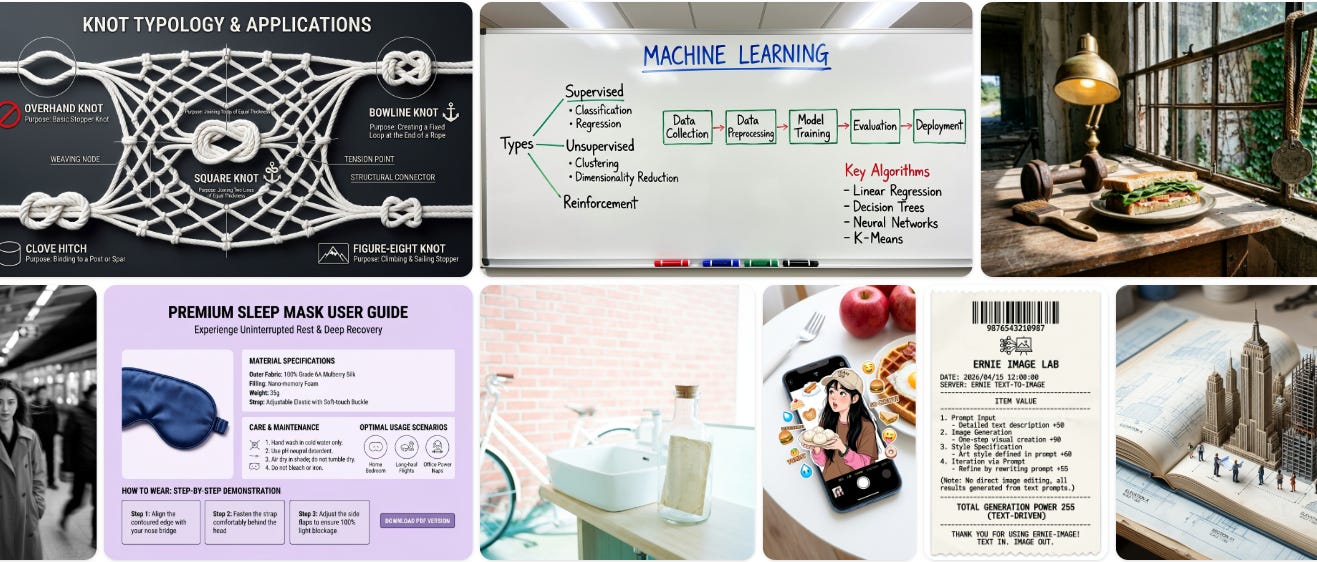

Baidu stellt das neue ERNIE‑Image vor: Starke Bildgenerierung mit wenig Ressourcen

Baidu stellt das neue ERNIE‑Image vor, ein kompaktes Text-zu-Bild-Modell mit 8 Milliarden Parametern. Das Modell überzeugt durch präzise Textdarstellung, zuverlässige Umsetzung komplexer Anweisungen und starke Ergebnisse bei strukturierten Layouts wie Posters oder Comics. Ein eingebauter Prompt Enhancer verwandelt kurze Eingaben in detailreiche Beschreibungen. ERNIE‑Image erzielt in mehreren Benchmarks Spitzenplätze, bietet eine breite Palette an Bildstilen und läuft effizient auf handelsüblicher Hardware.

Google bringt mit Gemini 3.1 Flash TTS ausdrucksstarke KI-Stimmen auf ein neues Level

Google hat Gemini 3.1 Flash TTS vorgestellt - ein Text-to-Speech-Modell, das mit natürlicherer, ausdrucksstarker Sprachausgabe und präziser Steuerung punktet. Entwickler und Unternehmen erhalten erstmals granularen Zugriff über sogenannte Audio-Tags, mit denen sich Sprechstil, Tempo und Ton gezielt beeinflussen lassen. Unterstützt werden über 70 Sprachen und Multi-Speaker-Dialoge. Ein besonderes Sicherheitsfeature ist die Wasserzeichnung per SynthID, die jede KI-generierte Audiodatei markiert - ein Schritt gegen Missbrauch und Fälschungen.

Lyra 2.0: Echtzeit-3D-Welten zum Erkunden und Simulieren

Lyra 2.0 von NVIDIA ermöglicht die Generierung interaktiver 3D-Umgebungen aus kameragesteuerten Videos, die anschließend zu hochwertigen 3D-Szenen rekonstruiert werden. Eine intuitive GUI erlaubt Nutzern, eigene Pfade in der Szene zu planen und sie dynamisch zu erweitern. Zwei zentrale Verbesserungen verhindern “Vergessen” von Bereichen und Fehlerakkumulation: Geometriespeicherung je Frame und Training mit selbstverschlechterten Videos. Exportierte Welten sind bereit für Physik-Simulationen, etwa zur Roboternavigation – ideal für skalierbare KI-Anwendungen und Forschung in immersiven Umgebungen.

Industrienachrichten

Sam Altman: Molotow-Angriff und Appell an die Vernunft

Sam Altman, CEO von OpenAI, teilt auf seinem Blog ein Familienfoto, um nach einem Molotow-Cocktail-Anschlag auf sein Haus weitere Attacken abzuschrecken. Er verknüpft den Vorfall mit einem kürzlich erschienenen „incendiary article“ über sich und reflektiert die Macht von Worten. Altman betont seine Überzeugungen: AI als mächtigstes Tool für menschliches Potenzial, Notwendigkeit gesellschaftlicher Resilienz, Demokratisierung der Technologie und Anpassungsfähigkeit. Persönlich gibt er Fehler zu, wie Konfliktvermeidung und den Streit mit dem Vorstand. Er plädiert für Deeskalation im KI-Milieu und breite Teilhabe statt Kontrolle durch wenige.

OpenAI öffnet neue Wege für Cyber-Verteidiger: GPT-5.4-Cyber und Trusted Access Programm

OpenAI skaliert sein Trusted Access for Cyber (TAC) Programm und stellt mit GPT-5.4-Cyber ein spezielles KI-Modell für Defensiv-Cybersecurity bereit. Ziel ist ein breiter Zugang für authentifizierte Verteidiger, gepaart mit intelligenten Schutzmechanismen und automatisierter Identitätsprüfung. Defensiv-orientierte Fähigkeiten wie Binäranalyse wurden integriert, während der Zugang schrittweise und mit besonderen Kontrollen erfolgt. Die Strategie basiert auf geprüften Nutzern, iterativer Einführung und ständiger Weiterentwicklung - um die Verteidigungsmaßnahmen parallel zu den KI-Fähigkeiten zu stärken.

Meta und Broadcom: Neue Chip-Partnerschaft für AI auf Gigawatt-Niveau

Meta und Broadcom kündigen eine enge Zusammenarbeit an, um mehrere Generationen von Meta’s MTIA-Chips („Meta Training and Inference Accelerator“) gemeinsam zu entwickeln. Ziel ist es, eine speziell auf KI-Workloads zugeschnittene Chipbasis zu schaffen, die Meta für KI-gestützte Funktionen in ihren Apps benötigt. Broadcom übernimmt dabei Chipdesign, Verpackung und Hochgeschwindigkeitsnetzwerke, basierend auf seiner XPU-Plattform. Bereits in der ersten Ausbaustufe will Meta mehr als 1 Gigawatt Rechenleistung einbringen – mit Ausblick auf weitere Steigerungen in den kommenden Jahren.

Zahlen, Studien, Wissenschaft

GPT-Rosalind: KI-Modell ebnet den Weg für schnellere Durchbrüche in den Life Sciences

GPT-Rosalind, benannt nach DNA-Pionierin Rosalind Franklin, ist ein neues KI-Modell, das speziell für biologische Forschung, Wirkstoffentwicklung und Biomedizin optimiert wurde. Es unterstützt Forscher bei datenintensiven Aufgaben wie Literaturrecherche, Hypothesengenerierung, Versuchsplanung und Datenanalyse, indem es komplexe Abläufe effizient verknüpft. Durch Partnerschaften mit Unternehmen wie Amgen, Moderna und Thermo Fisher Scientific wird GPT-Rosalind bereits in vielfältigen biowissenschaftlichen Workflows eingesetzt und hat in wissenschaftlichen Benchmarks Spitzenleistungen erzielt.

Künstliche Neuronen beschleunigen das Gehirnkartenzeichnen

Forschende bei Google nutzen KI-generierte, künstliche Neuronen, um das aufwendige Kartieren von Gehirnen effizienter zu machen. Ihr Modell „MoGen“ erzeugt realistisch geformte, synthetische Nervenzellen für das KI-Training und senkt Fehler beim Erstellen von Gehirnkarten um 4,4 %. Auf große Projekte skaliert, spart dies zahlreiche Jahre an Handarbeit. Besonders profitieren künftige Projekte wie die Kartografierung ganzer Mäuse- oder sogar Menschengehirne davon.

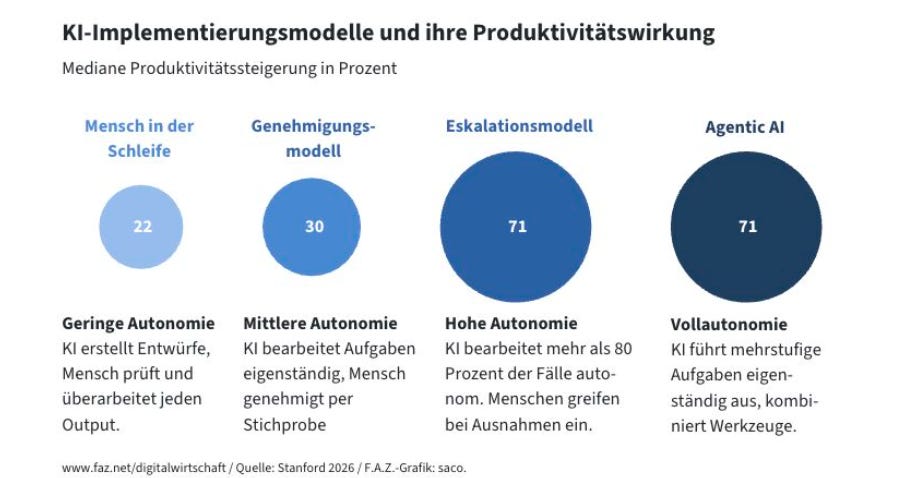

Warum Produktivität durch KI selten über Nacht kommt

Zwischen KI-Vorreitern und dem Rest der Wirtschaft wächst der Abstand: Während wenige Spitzenunternehmen Produktivitätssteigerungen von bis zu 71 Prozent erzielen, bleibt der Großteil ohne sichtbaren Nutzen. Laut einer Stanford-Studie liegt das an der Produktivitäts-J-Kurve – anfangs bremsen Investitionen, bevor sie wirken. Entscheidender Hebel ist nicht die Technik, sondern der radikale Umbau von Prozessen, begleitet von Schulung und Management-Unterstützung. Fast zwei Drittel der erfolgreichen Projekte erleben Fehlschläge; am Ende gewinnt, wer iterativ lernt und bereit ist, sich konsequent neu zu erfinden.

Ich wünsche Ihnen ein schönes Wochenende!

Prompt Well and Prosper!

Ihr

Martin Blaha

Das KI-Update ist eine wöchentliche Publikation, die von Martin Blaha (3pconsulting.net) produziert wird. Kontakt- und Geschäftsanfragen gerne über LinkedIn.